Lecture 11: Artificial neural networks (ANNs), backpropagation, representation learning. Graph neural networks (GNNs). Distributed neural networks. Case studies to social systems, systems biology & computer systems research

강의 개요

이번 강의는 딥러닝의 주요 개념인 Deep Neural Networks (DNNs), Recurrent Neural Networks (RNNs), Graph Neural Networks (GNNs)를 다룬다. 주요 초점은 각 모델의 구조, 학습 알고리즘, 그리고 대표적인 응용 사례에 맞춰져 있다.

1. Machine Learning (ML)의 기본 개념

- ML 정의

데이터를 기반으로 패턴을 자동으로 탐지하고, 불확실한 미래 데이터를 예측하는 수학적 방법. - 데이터 표현

- 벡터, 행렬, 텐서의 조합.

- 회귀, 분류 문제 해결을 위한 모델 설계.

- 학습 과정

- 데이터로부터 모델이 학습하고, 미래 데이터를 예측.

- "모든 모델은 틀렸지만, 몇몇 모델은 유용하다"라는 관점에서 모델 평가.

2. Deep Neural Networks (DNNs)

- 구조

- 입력층, 다수의 은닉층, 출력층으로 구성.

- 비선형 활성화 함수(ReLU, Sigmoid 등)가 사용된다.

- Linear: $W_k x_{k-1} + b_k$

- Nonlinear: $x_k = ReLU(W_k x_{k-1} + b_k ) = (W_k x_{k-1} + b_k )$

- Backpropagation

- 체인 룰을 활용하여 기울기를 계산하고 가중치를 업데이트.

- 활성화 함수

- ReLU: 그래디언트 소멸 문제 해결에 효과적.

- Sigmoid: 부드러운 출력값 제공하지만 계산 비용 높음.

- 응용

- 분류 문제: 이진 또는 다중 클래스 분류.

- 회귀 문제: 연속값 예측.

3. Recurrent Neural Networks (RNNs)

- 정의

- 시퀀스 데이터를 다루기 위해 설계된 신경망 구조.

- 시간 단계에서 데이터를 순차적으로 처리.

- 문제점

- 그래디언트 소멸 문제가 발생.

- LSTM(Long Short-Term Memory)

- 게이트 구조를 사용해 그래디언트 소멸 문제를 해결.

- 제한된 장기 메모리 제공.

- 응용

- 이미지 캡셔닝, 감정 분류, 비디오 프레임 분류.

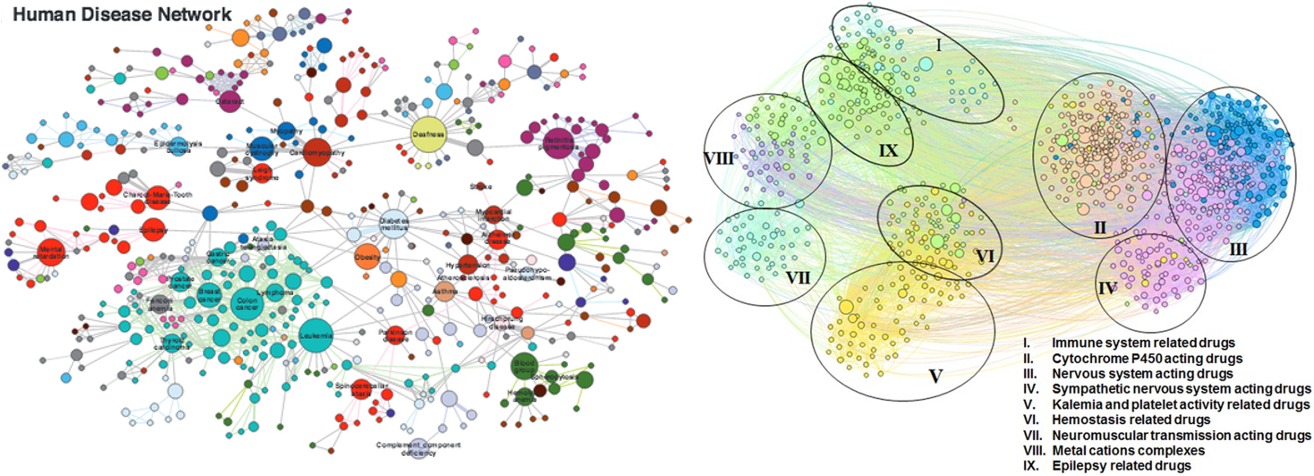

4. Graph Neural Networks (GNNs)

- 정의

- 그래프 구조 데이터를 학습하기 위한 신경망.

- 노드, 엣지, 그래프 전체를 대상으로 학습 가능.

- 작동 원리

- Message Passing: 이웃 노드에서 정보를 전달받아 집계.

- 노드 임베딩: 지역 정보를 사용해 노드 표현 생성.

- Graph Convolutional Networks (GCNs)

- 그래프에서 컨볼루션 연산을 수행하는 모델.

- 필터 파라미터를 그래프 전역에서 공유.

- 응용

- 의료 진단, 약물 개발, 추천 시스템(Uber Eats 등).

5. 고급 응용: Higher-Order Interactions

- Simplicial Complexes

- 2개 이상의 노드 간 상호작용을 모델링하는 고차 구조.

- 예: 질병-유전자 연관, 공동 저자 관계.

- Representation Learning

- 고차 데이터에서 효율적인 표현 학습.

- Relaxed Simplicial Complex를 통해 대규모 데이터 적용.

- 응용

- 생물학적 데이터(PPI, 질병 데이터).

- 논문 코-인용 네트워크(Cora, PubMed).

6. COPD 예측을 위한 DNN 응용

- 문제 정의

- COPD(만성 폐쇄성 폐질환)의 초기 진단은 어렵지만, 조기 발견 시 예후가 개선된다.

- FDDLM 모델

- Fractional Dynamic 기반 딥러닝 모델로 장단기 메모리 포착.

- 생리학적 신호 데이터를 통해 COPD 단계를 예측.

- 결과

- Wasserstein Distance(WD)를 사용하여 모델의 정확도를 평가.

- 다른 딥러닝 모델 대비 FDDLM의 예측 성능이 우수함.

결론

DNN, RNN, GNN은 각각 다른 유형의 데이터와 문제에 특화된 학습을 제공하며,

고급 응용 분야에서는 Simplicial Complex를 활용한 효율적인 표현 학습이 유망하다.

COPD 예측 사례는 딥러닝 모델의 실제 활용 가능성을 잘 보여준다.